Nelle ultime settimane OpenAI e Google hanno presentato due diversi progetti di immagini generate dall’intelligenza artificiale a partire da una semplice descrizione testuale

L’intelligenza artificiale sta facendo passi da gigante e sta correndo a una velocità che sorprende gli stessi scienziati che ci lavorano. Diverse aziende stanno lavorando a progetti di text-to-image, per creare immagini generate dall’intelligenza artificiale, immagini fotorealistiche originate da una semplice descrizione in linguaggio naturale.

La corsa a chi arriva primo (e meglio) in questo campo è appena iniziata e per ora sono due le big company che hanno messo in campo dei progetti di generazione immagini attraverso l’AI.

DALL·E 2 di OpenAI

La prima è OpenAI, un’organizzazione non profit di ricerca sull’intelligenza artificiale. Fondata nel 2015 da Elon Musk (che poi è uscito dal board nel 2018) vede ora fra i suoi dirigenti: Greg Brockman (ex CTO di Stripe), Ilya Sutskever (specialista del machine learning), Sam Altman (ex presidente di Y Combinator) e Adam D’Angelo (ex CTO di Facebook e CEO di Quora) e fra gli investitori anche la Microsoft.

OpenAI lo scorso aprile ha presentato DALL·E 2, la sua rete neurale capace di generare un’immagine a partire da una semplice frase descrittiva.

Queste reti neurali, partendo da poche parole, possono generare immagini ad alta risoluzione che non sono mai esistite, in qualunque stile si desideri: fotorealistico, illustrazione, dipinto a olio, acquerello, fumetto, 3D… addirittura possono imitare specifiche correnti artistiche o lo stile di un artista preciso, da Monet, a Picasso a Basquiat.

Ma non solo. Grazie all’AI è possibile modificare immagini già esistenti aggiungendo nuovi elementi che saranno integrati in maniera naturale e invisibile, tenendo conto di prospettiva, di luci, ombre e riflessi. O anche creare variazioni diverse da una foto o da un’opera d’arte realmente esistente e generare nuove immagini che non esistono nella realtà. Sul profilo Instagram di DALL·E 2 ci sono decine di esempi di immagini generate artificialmente.

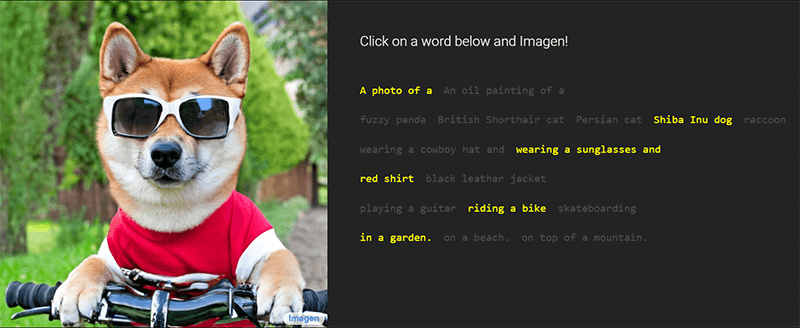

Imagen di Google Brain

L’altra big company ovviamente è Google che, attraverso Google Brain (il suo team di ricerca sull’intelligenza artificiale e deep learning) ha appena svelato Imagen, il suo nuovo sistema di immagini generate dall’intelligenza artificiale .

Anche Imagen genera immagini ad alta risoluzione a partire da un semplice testo

A quanto pare, in base alla valutazione di una giuria umana, le immagini generate da Imagen hanno una qualità addirittura migliore di quelle di DALL·E 2 e anche una migliore accuratezza e corrispondenza fra testo e immagine, ma entrambe le soluzioni hanno sostanzialmente le stesse funzionalità.

Ma in pratica come funziona un generatore di immagini?

Dato come input un testo che descrive l’immagine che vogliamo ottenere, l’output sarà un’immagine “disegnata” per noi dall’intelligenza artificiale. Più accurata e dettagliata sarà la nostra descrizione, più precisa risulterà l’immagine generata.

Se per esempio, vogliamo un’illustrazione di un astronauta che gioca a basket con dei gatti nello spazio, il risultato potrebbe essere questo.

DALL·E 2 dal testo all’immagine

Dietro a questo meccanismo apparentemente semplice ci sono anni di lavoro e sperimentazione sulle reti neurali e il machine learning, in cui l’intelligenza artificiale viene addestrata a mettere in relazione parole e immagini, il cosiddetto text-to-image. Successivamente l’AI deve essere in grado di generare le immagini componendo i diversi elementi con il fotoritocco come in un collage.

I rischi dei generatori di immagini artificiali

Per il momento sia OpenAI sia Google hanno presentato le loro demo mostrando immagini di simpatici animali antropomorfi o situazioni divertenti o surreali. Come sempre però, quando si tratta di nuove tecnologie, c’è sempre il pericolo che queste vengano utilizzate al di fuori degli scopi previsti.

Il rischio maggiore è che si possano generare immagini da utilizzare per usi illeciti ad esempio per creare immagini false per promuovere fake news. Un altro rischio è la possibilità che le associazioni testo-immagine possano generare stereotipi sociali o di genere oppure immagini offensive per qualche minoranza. Ecco perchè per il momento entrambi i progetti sono ancora in fase demo, con numerose limitazioni anche sulle parole che è possibile utilizzare e non sono ancora disponibili al grande pubblico. Le potenzialità di questa tecnologia però sono enormi quindi non ci resta che aspettare e vedere come si evolveranno questi generatori di immagini artificiali!

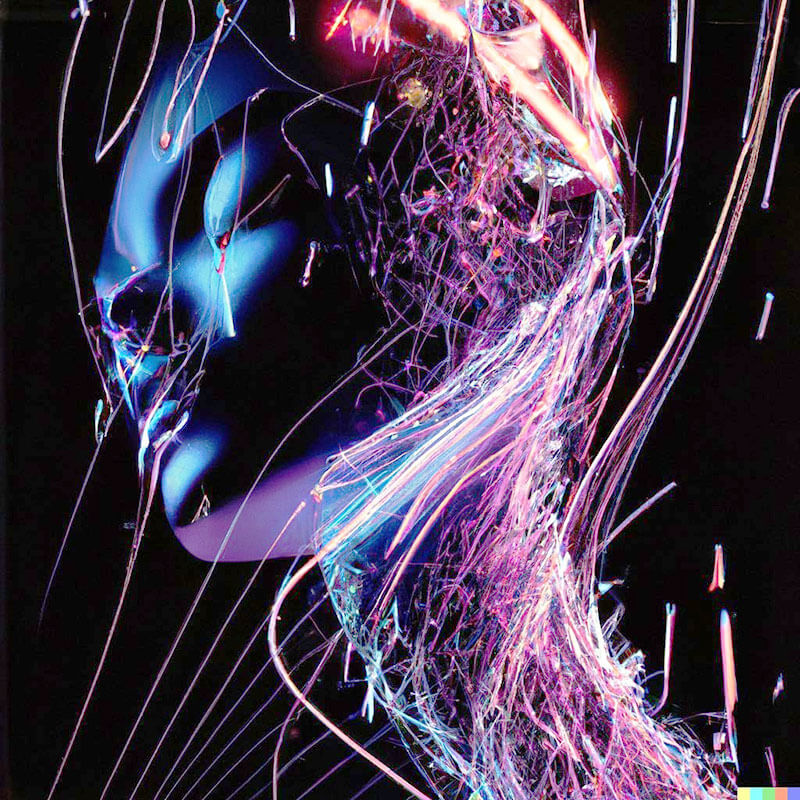

Immagine generata da DALL·E 2 nello stile di Claude Monet

Questa immagine non esiste: è stata generata dall’intelligenza artificiale di Imagen

• LEGGI ANCHE: Fotografia concettuale: i corpi volanti di Rob Woodcox

Come si evince dal contesto, le immagini digitali possono essere manipolate per false comunicazioni. È la problematica dei social, anzi più delicata perch l’immagine colpisce più dello script. È necessaria una regolamentazione, il più presto possibile..